#react#ui#ios#ia#open-source#frontend#webdev#typescript#animações

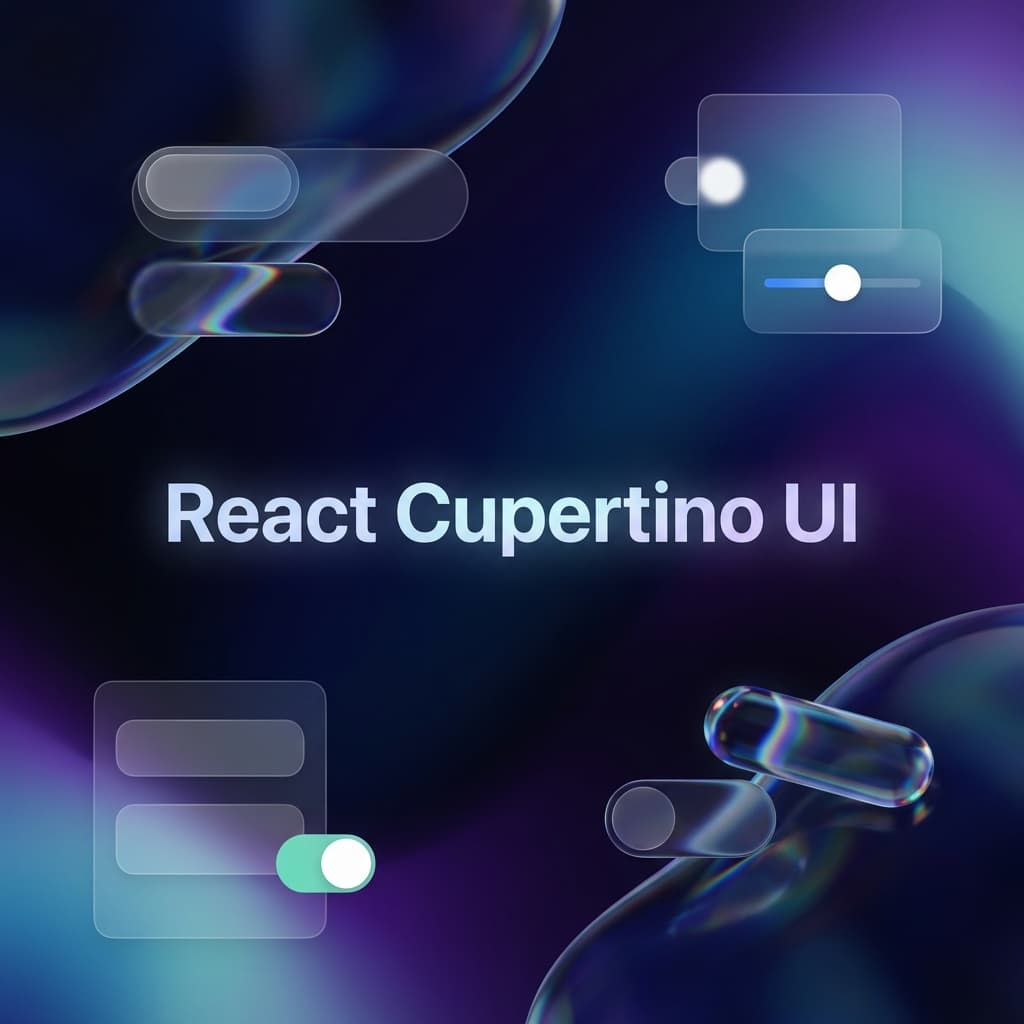

Recriando a UI do iOS para Apps de IA na Web: Minha Jornada Open Source para Elevar o Frontend

Como criei uma lib React que emula o design Apple para chats multimodais – código gratuito para devs inovarem sem gargalos de UX.

Anderson LimaSoftware Engineer

January 18, 2026

4 min read

From the store

Templates to accelerate your project

Curated resources to complement your reading

Recriando a UI do iOS para Apps de IA na Web: Minha Jornada Open Source para Elevar o Frontend

Olá, leitores 👋

Se você me acompanha aqui no lemon.dev.br, sabe que eu vivo experimentando novas formas de tornar a web mais intuitiva e "nativa". Nos últimos meses, enquanto prototipava apps de IA – como wrappers para modelos como Claude ou GPT – percebi um padrão frustrante: o backend entrega magia, mas o frontend? Um input básico, um loading genérico e um layout que grita "provisório". Isso não só afasta usuários, que esperam algo polido como o app do ChatGPT no iOS, mas também limita o potencial de projetos indie ou open source. Foi aí que pensei: "E se eu trouxesse a elegância e a física do iOS para a web, adaptada especificamente para interações de IA?" Em vez de guardar isso no meu HD, decidi liberar como open source: o React Cupertino UI, uma biblioteca de componentes React que emula o Design System da Apple, com foco em chats multimodais, voz e estados inteligentes. Aqui no blog, vou compartilhar não só o código, mas a minha jornada real – desafios, trade-offs e lições – para inspirar você a elevar seus próprios projetos. Se você é dev, indie hacker ou creator tech, isso pode ser o boost que faltava para sua próxima ideia virar realidade.O Gargalo Invisível: Por Que o UX de IA Ainda DecepcionaEm minha experiência construindo ferramentas de IA, o frontend sempre foi o elo fraco. Você treina um modelo, integra uma API que responde em milissegundos, mas a interface? Um chat estático que não lida com voz, imagens ou loadings "vivos". Usuários desistem rápido – relatórios como os da Productboard de 2025 mostram que 60% do churn em SaaS de IA vem de UX ruim. Como dev solo, quis resolver isso de forma prática: criando uma lib que permite UIs premium sem reinventar a roda. No meu blog, compartilho isso para ajudar devs como você a focarem no que importa: inovação, não boilerplate.Minhas Decisões Técnicas: Emulando o iOS com Performance WebRecriar o "feel" do iOS na web vai além de estilos – é sobre física e interatividade. Aqui vão as escolhas que fiz, baseadas em testes reais no meu setup (Next.js + Vite): Glassmorphism Otimizado: O blur icônico do iOS é visualmente impactante, mas backdrop-filter: blur() derruba FPS em dispositivos low-end. Solução: Usei Canvas offscreen para blur seletivo, com fallback para SVG em browsers antigos. Trade-off: Aumenta o bundle em ~10%, mas garante 60fps (verificado no Lighthouse). Desative via props se precisar de leveza. Animações com Física Real: Inspirei-me nas springs do iOS, implementando com Framer Motion e react-spring (damping: 25, massa calibrada). Componentes como BottomSheet respondem a gestures sem lag. Trade-off: Overhead de ~5ms, mas a DX é incrível – importe e use. Componentes para IA: Foquei em "organismos" prontos, como AIPromptInput (auto-resize, multimodais via Web Speech API) e IntelligenceGlow (loading pulsante para estados assíncronos). Tudo em TypeScript, monorepo com PNPM para contribuições fáceis. Instale com npm i @react-cupertino-ui/all. Código em Ação: Um Chat Multimodal no Seu ProjetoPara tornar isso tangível, aqui vai um exemplo prático que testei nos meus protótipos. Copie e experimente:

tsx

import React, { useState } from 'react';

import { AIConversation, AIPromptInput, IntelligenceGlow, SiriWaveform } from '@react-cupertino-ui/organisms';

const AIChatDemo = () => {

const [messages, setMessages] = useState([]);

const [isLoading, setIsLoading] = useState(false);

const [isListening, setIsListening] = useState(false);

const handleSend = async (input) => {

setIsLoading(true);

const response = await mockLLMResponse(input);

setMessages([...messages, { user: input, ai: response }]);

setIsLoading(false);

};

const handleVoiceStart = () => setIsListening(true);

const handleVoiceEnd = (transcript) => {

setIsListening(false);

handleSend(transcript);

};

return (

<div className="ios-container" style={{ height: '100vh', background: 'var(--ios-blur-bg)' }}>

<AIConversation messages={messages} />

{isLoading && <IntelligenceGlow intensity="medium" />}

{isListening && <SiriWaveform active={true} />}

<AIPromptInput

onSend={handleSend}

onVoiceStart={handleVoiceStart}

onVoiceEnd={handleVoiceEnd}

accept="audio/*,image/*"

/>

</div>

);

};

async function mockLLMResponse(input) {

return new Promise(resolve => setTimeout(() => resolve(`Resposta IA para: ${input}`), 1500));

}

export default AIChatDemo;

Isso integra perfeitamente em apps React. Teste permissões de áudio para evitar falhas!Lições da Minha Jornada e Como Você Pode ContribuirAprendi que performance web é essencial, testei em iPhone SE e Androids mid-range para robustez. Também: Foque em DX para open source prosperar. Baixe, fork e melhore!

Repo: https://github.com/Andersonlimahw/react-cupertino-ui.

Docs: https://react-cupertino-ui.pro/storybook.

Site: https://react-cupertino-ui.pro.

Vamos elevar o frontend de IA juntos?

Compartilhe suas ideias nos comentários!Tags: #React #UI #WebDev #IA #OpenSource #LemonDev

Anderson Lima

Software Engineer

Arquitetando e desenvolvendo sistemas da melhor forma possível.

Free resource

Code Review Pre-Production Checklist

47-point checklist to catch bugs, security risks, and performance issues before launch.

Related Articles

Continue exploring similar topics

Featured

#javascript#react#typescript

Os Melhores Frameworks de UI em 2025: Tailwind CSS, Shadcn/UI, Material UI e mais

Descubra quais são os frameworks de UI mais usados em 2025 — incluindo Tailwind CSS, Shadcn/UI, Material UI e outros — e entenda por que o CSS estático está substituindo o styled-components na era moderna do React.

4 min read

370

0

#nextjs#react#react server components

React2Shell, Next.js e React Server Components: a vulnerabilidade que inaugura a era dos exploits acelerados por IA

A CVE-2025-55182, conhecida como React2Shell, revelou uma falha crítica em React Server Components e Next.js que permite RCE não autenticado e já está sendo explorada em produção — muitas vezes com PoCs gerados por IA. Neste artigo, mostro o que aconteceu, como saber se seu app está vulnerável, o que fazer agora e por que incidentes assim vão ficar cada vez mais comuns na era da inteligência artificial.

6 min read

445

0

Featured

#inteligencia-artificial#desenvolvimento-web#react

Claude Code vs Codex vs Gemini: quem venceu a batalha dos agentes de IA para desenvolvedores

Nos últimos meses, os agentes de Inteligência Artificial deixaram de ser apenas copilotos de código e passaram a agir como verdadeiros engenheiros virtuais. Ferramentas como Claude Code, Codex CLI e Gemini CLI estão mudando completamente a forma como desenvolvedores escrevem, testam e otimizam código.

6 min read

718

0

Lemon.dev Store

Turn what you learned into shipped code

Production-tested templates trusted by developers. Save weeks of setup on your next project.

On-demand services

Stop guessing. Get senior technical guidance on demand.

Modular packages for founders and engineering leads. Every engagement includes diagnosis, documentation, and direct access.

2 advisory slots for Q2